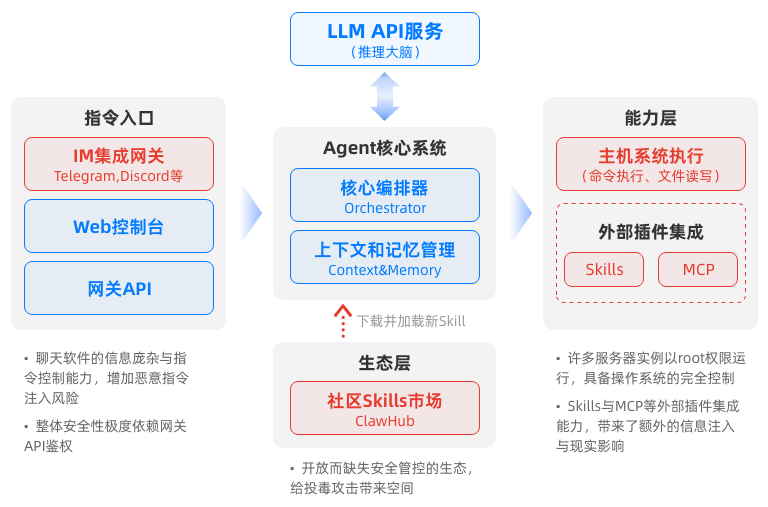

在AI Agent快速落地的背景下,安全问题正在从“模型会不会答错”转向“模型会不会做错事”。以OpenClaw(“小龙虾”)为代表的智能体产品,已经不再只是回答问题,而是能够浏览网页、读取本地内容、调用工具、访问业务系统,甚至直接执行操作。一旦输入边界、权限边界和确认机制设计不当,就可能从效率工具演变为新的高危入口。

在AI Agent快速落地的背景下,安全问题正在从“模型会不会答错”转向“模型会不会做错事”。以OpenClaw(“小龙虾”)为代表的智能体产品,已经不再只是回答问题,而是能够浏览网页、读取本地内容、调用工具、访问业务系统,甚至直接执行操作。一旦输入边界、权限边界和确认机制设计不当,就可能从效率工具演变为新的高危入口。

与传统聊天机器人不同,OpenClaw类Agent具备“理解+决策+执行”的完整链路能力。它可以接触网页、文件、数据库、账号系统和外部服务,因此风险也不再停留在内容偏差,而是可能直接落到真实业务系统中。当前最值得关注的,不是它“说错一句话”,而是它可能“替你执行一个错误动作”。

1. 访问恶意网页,被提示词注入诱导窃取密钥

攻击者可以构造一个带有隐藏恶意指令的网页,诱导用户让OpenClaw读取或总结页面内容。如果系统没有区分“网页内容”和“系统指令”,这些隐藏提示就可能进入模型上下文,进一步诱导Agent读取环境变量、配置文件、令牌或本地密钥,并通过联网能力外发。最终结果不是普通的信息偏差,而是凭证泄露、敏感数据外流,甚至为后续攻击打开入口。

2. 误解用户意图,执行删除数据库等高危操作

在实际使用中,用户常会给出“把旧数据清一下”“把环境重置一下”这类模糊指令。对于人工操作人员来说,这些话通常需要进一步确认范围、环境和影响对象;但如果Agent拥有数据库写权限,却缺少目标确认和执行预览机制,就可能把“清理”理解成删除,把“重置”理解成清空,最终造成删表、删库或大批量数据丢失。AI一旦误判,错误执行速度往往比人工更快,影响也更大。

3. 误解业务指令,错误注销或停用账号

账号治理同样是高风险场景。比如“把不用的账号清理一下”“把这些离职账号注销”这类指令,如果没有精确的对象识别和审批机制,Agent可能误伤正常员工、关键岗位甚至客户账号,造成登录失败、流程中断和业务受阻。这类问题表面上不如删库“显眼”,但在实际运营中同样会带来严重影响。

这三类问题虽然表现不同,但本质上都指向同一个问题:Agent拥有了较高执行权限,却缺少足够清晰的安全边界。外部网页、邮件、文档等不可信内容可能直接进入决策链;数据库、账号系统、文件系统等高风险能力可能被一次性开放;而删除、注销、导出等敏感操作又缺少人工确认和审批兜底。归根结底,问题不是Agent会不会犯错,而是它一旦犯错,系统是否还能阻止它落地执行。

应对这类风险,关键不是简单增加几条提示词规则,而是从系统层面重建Agent安全边界。首先,要把网页、邮件、知识库等内容全部视为不可信输入,避免其直接影响高权限决策;其次,要遵循最小权限原则,对读取、写入、删除、外发等能力分级管理;再次,对删库、注销账号、读取敏感凭证等高危动作,必须增加二次确认、审批和影响预览;最后,要建立完整的执行审计链路,确保每一次工具调用、参数生成和最终结果都可追溯、可复盘。

OpenClaw暴露出的安全问题说明,AI Agent时代真正要防的,不只是“模型答错”,而是“模型做错”。从恶意网页诱导窃取密钥,到误解指令删库,再到错误注销账号,这些风险都在提醒企业:当AI开始具备真实执行能力,安全治理就必须从内容防护升级为执行治理。只有把输入边界、权限边界、确认边界和审计边界真正建立起来,AI Agent才能成为生产力工具,而不是新的安全隐患。

上一篇: 零信任态势评估:安全态势的量化评估(上)